GPU‑Server für generative KI im Mittelstand

Maximale Performance. Volle Kontrolle. Maßgeschneidert von Nelpx.

Generative KI ist im Mittelstand angekommen – aber ohne die passende Infrastruktur bleiben viele Projekte im Pilotstatus stecken. Während Public‑Cloud‑Dienste auf den ersten Blick bequem wirken, zahlen Mittelständler spätestens bei wachsender Nutzung mit hohen, schwer kalkulierbaren Kosten und begrenzter Kontrolle über ihre Daten. Genau hier setzen eigene GPU‑Server an: Sie bringen die Rechenleistung moderner KI‑Modelle direkt in Ihr Rechenzentrum oder Ihren Serverraum – sicher, performant und kalkulierbar.

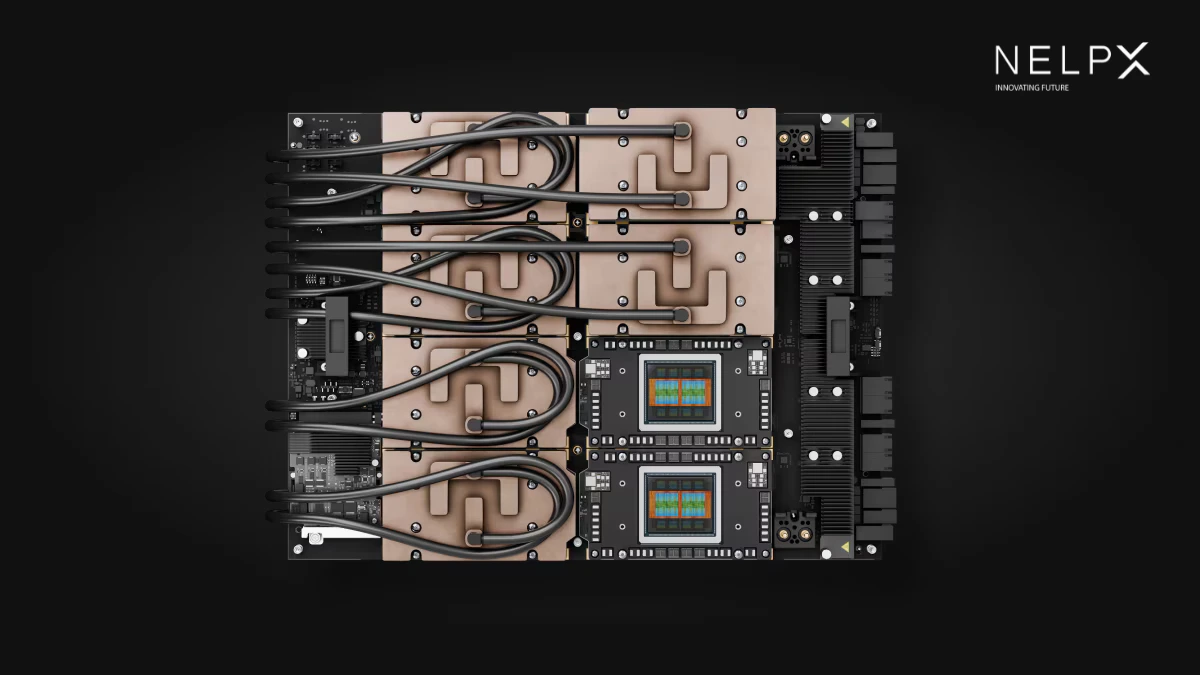

Nelpx GmbH entwickelt und liefert maßgeschneiderte GPU‑ und HPC‑Server, die speziell auf die Anforderungen mittelständischer Unternehmen zugeschnitten sind – auf Wunsch vollständig wassergekühlt, für maximale Performance bei minimaler Lautstärke und optimaler Energieeffizienz.

Call to Action: Sprechen Sie mit unseren Experten und erhalten Sie ein GPU‑Server‑Konzept, das exakt zu Ihren KI‑Use‑Cases und Ihrem Budget passt.

Vorteile von eigenen GPU‑Servern für den Mittelstand

Mit einem eigenen GPU‑Server schaffen Sie die Basis, um generative KI im Unternehmen produktiv und wirtschaftlich zu betreiben – von Text- und Code‑Generierung bis hin zu Bild-, Video- und Sprachmodellen.

Kalkulierbare Kosten statt Cloud‑Falle

Einmal investieren, langfristig profitieren: Statt stetig steigender Cloud‑Rechnungen nutzen Sie planbare CapEx‑Investitionen und reduzieren Ihre laufenden Opex‑Kosten deutlich – gerade bei dauerhaft laufenden KI‑Workloads.

Volle Datenhoheit und Compliance

Ihre sensiblen Daten bleiben in Ihrem Netzwerk: Das erleichtert die Erfüllung von Compliance‑Anforderungen (z.B. DSGVO, Kundenverträge, Branchenrichtlinien) und minimiert rechtliche Risiken durch externe Datenhaltung.

Planbare Performance ohne geteilte Ressourcen

Keine geteilten GPU‑Ressourcen, keine Nachbarn, die Ihnen Kapazität wegnehmen: Ihre Workloads erhalten konstant hohe Performance, was Trainingszeiten verkürzt und Inference‑Latenzen stabil hält.

Optimiert für Ihre Use‑Cases statt von der Stange

Ob Sie interne Chatbots, Copilot‑Funktionen für Mitarbeiter, Bild‑Generierung oder Code‑Assistenz aufbauen – Ihre Hardware wird so dimensioniert, dass sie Ihren konkreten Use‑Cases optimal entspricht.

Technologische Unabhängigkeit

Mit eigener Infrastruktur vermeiden Sie Abhängigkeiten von einzelnen Hyperscalern und deren Preismodellen. Sie behalten die Freiheit, Tools, Frameworks und Modelle zu wählen, die wirklich zu Ihnen passen.

Typische generative KI‑Use‑Cases im Mittelstand

Viele mittelständische Unternehmen stehen vor ähnlichen Herausforderungen: Prozesse sind fragmentiert, Fachwissen steckt in Köpfen oder Dokumenten, Kunden erwarten immer schnellere Antworten. Generative KI kann hier zum Produktivitäts‑Booster werden.

Interne KI‑Assistenten für Fachabteilungen (Vertrieb, Service, HR, Einkauf, Fertigung)

Dokumenten‑ und Wissens‑Chatbots, die interne Anleitungen, Verträge und technische Dokumentation beantworten

Code‑Assistenz und Automatisierung in der internen Softwareentwicklung

Marketing‑ und Content‑Generierung (Produkttexte, Kampagnen‑Entwürfe, Social‑Media‑Ideen)

Bild- und Video‑Generierung für Produktvisualisierungen, Prototyping oder Schulungsinhalte

Sprach‑Use‑Cases wie Transkription, Zusammenfassung von Meetings, Voice‑Bots

Mit einem eigenen GPU‑Server können Sie diese Use‑Cases stufenweise einführen – zunächst als Pilot, dann als produktiven Service für ganze Abteilungen oder Standorte.

On‑Prem statt reine Cloud: Die ideale Hybrid‑Strategie

Die Zukunft liegt oft nicht im „entweder oder“, sondern im „sowohl als auch“. Viele Mittelständler fahren mit einem Hybrid‑Modell am besten: kurzfristige Experimente und Tests in der Cloud, produktive und sensitive Workloads auf eigenen GPU‑Servern.

Tests und Proof‑of‑Concepts in der Cloud

Produktive KI‑Services für Mitarbeiter und Kunden auf eigenem GPU‑Server

Sensible Daten verbleiben im eigenen Netzwerk

Kostenintensive Dauer‑Workloads (z.B. Chatbots, Copilots) laufen lokal

Integration in Ihre bestehende IT‑Landschaft (AD, IAM, Monitoring, Backup)

Nelpx unterstützt Sie dabei, diese Hybrid‑Architektur so aufzubauen, dass Sie die Vorteile beider Welten nutzen und gleichzeitig Kosten, Sicherheit und Komplexität im Griff behalten.

Wassergekühlte GPU‑Server: Maximale Performance, minimale Probleme

Klassische luftgekühlte Server stoßen bei hochdichten GPU‑Systemen schnell an Grenzen. Lautstärke, Abwärme, thermische Drosselung und ein hoher Energieverbrauch sind häufige Probleme. Mit wassergekühlten GPU‑Servern lösen Sie genau diese Punkte.

Ihre Vorteile mit wassergekühlten Systemen

Stabile Peak Performance

Wassergekühlte GPUs laufen dauerhaft im optimalen Temperaturbereich, ohne thermisches Throttling. Das bedeutet konstant hohe Taktfrequenzen und maximale Rechenleistung – auch unter Volllast.

Mehr Leistung auf weniger Fläche

Höhere Leistungsdichte je Rack‑Unit: Sie können mehr GPUs und mehr Rechenleistung auf kleinerem Raum unterbringen, ohne dass Ihr Serverraum zur Sauna wird.

Weniger Geräuschentwicklung

Weniger oder langsamere Lüfter senken die Lärmbelastung deutlich – ein wichtiger Faktor, wenn Serverräume in Nähe von Arbeitsbereichen liegen.

Bessere Energieeffizienz

Effiziente Kühlung reduziert Energiekosten und macht es leichter, Nachhaltigkeits‑Ziele und interne Green‑IT‑Strategien zu erreichen.

Langlebigkeit der Hardware

Gleichmäßige Temperaturen schonen Komponenten und erhöhen die Lebensdauer Ihrer Investition.

Nelpx plant und liefert auf Wunsch komplett wassergekühlte HPC‑ und GPU‑Serverlösungen – inklusive Planung der Kühlkreisläufe und Abstimmung mit Ihren räumlichen Gegebenheiten.

Typische GPU‑Server‑Profile für generative KI

Jeder Mittelständler hat unterschiedliche Anforderungen. Statt eines Einheitsprodukts erhalten Sie bei Nelpx konkrete Konfigurationen, die sich an Ihren Use‑Cases orientieren. Beispiele:

1. Kompakter Inference‑Server für interne KI‑Assistenz

Ideal für: interne Chatbots, Dokumenten‑Q&A, leichte Bild‑ und Text‑Use‑Cases.

1–2 GPUs (z.B. NVIDIA der aktuellen Rechenzentrums‑Generation)

Hohe RAM‑Ausstattung für mehrere parallele Sessions

Schnelle NVMe‑SSDs für Modell‑ und Embedding‑Speicher

Ausgelegt auf niedrige Latenz und hohe Verfügbarkeit

2. Performance‑Cluster für mehrere Teams und Standorte

Ideal für: parallele Nutzung durch verschiedene Abteilungen, mehrere LLM‑Instanzen, Kombination aus Inference und leichtem Fine‑Tuning.

4–8 GPUs pro Node, skalierbar über mehrere Nodes

High‑Speed‑Netzwerk (z.B. 100 GbE oder schneller) für schnellen Modell‑ und Datenzugriff

Getrennte Ressourcenpools für verschiedene Abteilungen oder Projekte

Optionale Wasser‑Kühlung für dauerhaft hohe Auslastung

3. HPC‑System für anspruchsvolle KI‑Workloads und Training

Ideal für: Fine‑Tuning größerer Modelle, komplexe KI‑Pipelines, Kombination aus klassischem HPC und KI.

8+ GPUs mit hohem GPU‑zu‑GPU‑Durchsatz

Große RAM‑Konfiguration, schneller Parallel‑Storage

Optimiert für Batch‑Training, längere Läufe und anspruchsvolle Experimente

Vollständig wassergekühlt für maximale Stabilität unter Dauerlast

Alle Profile verstehen wir als Startpunkt – die konkrete Ausprägung entwickeln wir gemeinsam mit Ihnen.

Einfache Integration in Ihre bestehende IT‑Landschaft

Ein GPU‑Server ist nur dann wertvoll, wenn er sich reibungslos in Ihre vorhandene IT integriert. Deshalb achten wir bei Nelpx darauf, dass Technologie nicht zum Fremdkörper wird, sondern sich wie ein natürlicher Bestandteil Ihrer Umgebung anfühlt.

Anbindung an bestehende Identitäts‑ und Berechtigungssysteme (z.B. Active Directory, SSO)

Einbindung in Ihr Monitoring (z.B. bestehende Monitoring‑Tools, Log‑Systeme)

Integration in Backup‑ und Recovery‑Konzepte

Netzwerkanbindung nach Ihren Sicherheitsvorgaben (Segmentierung, Firewalls, DMZ‑Konzepte)

Unterstützung gängiger Frameworks und Runtimes (z.B. PyTorch, TensorFlow, Open‑Source‑LLMs, Container‑Umgebungen)

Sie erhalten von Nelpx keinen isolierten „KI‑Klotz“, sondern einen sauber integrierten Baustein Ihrer IT‑Architektur.

Sicherheit, Governance und Compliance im Fokus

Gerade im Mittelstand ist Vertrauen entscheidend – intern wie extern. Wenn Mitarbeitende mit KI‑Systemen arbeiten, muss klar sein, dass Daten vertraulich behandelt und sicher verarbeitet werden.

Datenverarbeitung in Ihrem eigenen Rechenzentrum oder Serverraum

Klare Zugriffskonzepte: Wer darf welche Modelle, Prompts und Daten verwenden?

Trennung von Test‑ und Produktionsumgebungen

Protokollierung relevanter Aktivitäten für Revisions- und Compliance‑Anforderungen

Unterstützung bei der Definition von Richtlinien zur Nutzung generativer KI im Unternehmen

Nelpx begleitet Sie nicht nur technisch, sondern hilft Ihnen dabei, KI‑Infrastruktur und Governance‑Anforderungen unter einen Hut zu bringen.

Vorgehensweise: So laufen GPU‑Projekte mit Nelpx ab

Damit Sie schnell zu produktiven Ergebnissen kommen, folgt jedes Projekt bei Nelpx einem strukturierten, aber pragmatischen Ablauf:

Use‑Case‑Analyse

Gemeinsam klären wir, welche generativen KI‑Anwendungen Sie kurz-, mittel- und langfristig planen und welche Daten dafür relevant sind.

Kapazitäts‑ und Architekturplanung

Auf Basis Ihrer Anforderungen definieren wir Performance‑Ziele, GPU‑Anzahl, Speicherbedarf, Netzwerk‑Anbindung und Kühlkonzept (Luft oder Wasser).

Individuelles Systemdesign

Wir erstellen ein auf Ihren Bedarf zugeschnittenes Server‑Design inklusive konkreter Komponenten, Ausbaupfade und Integration in Ihre Infrastruktur.

Angebot und Feinspezifikation

Sie erhalten ein transparentes Angebot inklusive Varianten, damit Sie Investition, Laufzeit und Ausbauoptionen sauber bewerten können.

Lieferung, Installation und Inbetriebnahme

Auf Wunsch begleiten wir die komplette Inbetriebnahme – vom Rack‑Einbau über die Einrichtung der Software‑Stacks bis zu ersten Test‑Workloads.

Optimierung und Support

Nach dem Go‑Live helfen wir bei Feintuning, Monitoring, Kapazitätsplanung und künftigen Erweiterungen.

Für wen sich Nelpx GPU‑Server besonders lohnen

Unsere GPU‑ und HPC‑Server sind besonders interessant für mittelständische Unternehmen, die:

generative KI strategisch einsetzen wollen, statt nur einzelne Tools zu testen

sensible Daten und Wissen im eigenen Haus behalten müssen oder wollen

Wert auf planbare Kosten und klare ROI‑Argumente legen

mehrere Standorte oder Teams mit zentraler KI‑Infrastruktur versorgen möchten

bereits heute Performance‑Engpässe bei Cloud‑Lösungen oder klassischen Servern feststellen

Nachhaltigkeit und Energieeffizienz (z.B. durch moderne Kühlkonzepte) ernst nehmen

Wenn Sie sich in diesen Punkten wiederfinden, sind maßgeschneiderte GPU‑Server ein logischer nächster Schritt.

Ihr nächster Schritt: Mit Nelpx zur eigenen KI‑Infrastruktur

Sie möchten generative KI vom Experiment zur produktiven Unternehmensressource machen – und dafür eine Infrastruktur, die zu Ihrem Mittelstandsbusiness passt? Dann ist jetzt der richtige Zeitpunkt, den Grundstein zu legen.